Now vibe coding, so learning hammer FE ?

《在本地终端预览OpenGraph卡片》

标签:#前端 #OpenGraph #CLI工具 #Zig #Kitty图形协议 #开发工具

总结:

作者为解决OpenGraph调试痛点,开发了CLI工具

文章要点:

- 传统OG调试流程繁琐:需要部署到公网或使用隧道工具,且Facebook等平台的调试器缓存机制会导致反复迭代困难

-

- 终端图片渲染基于Kitty图形协议,兼容Ghostty、iTerm2、WezTerm等主流终端,不支持的终端会自动降级为文本输出

- 工具内部使用Zig的

- 提供四种输出模式:OpenGraph预览(默认)、Twitter Card预览、表格视图、JSON格式,后者支持管道操作(如配合jq使用)

- 具备校验功能:当缺少必需的OG字段(title、type、image、url)时会输出错误并返回非零退出码,适合集成到CI流程作为布局模板检查

- 安装方式灵活:支持预编译二进制、源码编译(Zig 0.15+)和mise工具管理

文章URL:https://simonhartcher.com/posts/2026-04-15-testing-opengraph-on-localhost-from-the-cli/

标签:#前端 #OpenGraph #CLI工具 #Zig #Kitty图形协议 #开发工具

总结:

作者为解决OpenGraph调试痛点,开发了CLI工具

og-check,可直接在终端内渲染本地开发环境的OG卡片预览,无需部署到公网或使用隧道服务。工具基于Zig编写,支持Kitty图形协议在终端内显示图片,并提供OpenGraph、Twitter Card、表格和JSON四种输出格式,同时可作为CI检查工具确保OG标签完整性。文章要点:

- 传统OG调试流程繁琐:需要部署到公网或使用隧道工具,且Facebook等平台的调试器缓存机制会导致反复迭代困难

-

og-check支持在本地终端直接预览OG卡片,包含图片渲染,将反馈周期从分钟级缩短到秒级- 终端图片渲染基于Kitty图形协议,兼容Ghostty、iTerm2、WezTerm等主流终端,不支持的终端会自动降级为文本输出

- 工具内部使用Zig的

std.http.Client抓取页面,解析meta标签并按命名空间分类(og:、twitter:等),通过zigdown渲染Markdown到终端- 提供四种输出模式:OpenGraph预览(默认)、Twitter Card预览、表格视图、JSON格式,后者支持管道操作(如配合jq使用)

- 具备校验功能:当缺少必需的OG字段(title、type、image、url)时会输出错误并返回非零退出码,适合集成到CI流程作为布局模板检查

- 安装方式灵活:支持预编译二进制、源码编译(Zig 0.15+)和mise工具管理

文章URL:https://simonhartcher.com/posts/2026-04-15-testing-opengraph-on-localhost-from-the-cli/

《OpenHarness:开源智能体基础设施框架》

标签:#AI #Agent #智能体 #开源 #Python #工具调用

总结:

OpenHarness是港大数据智能实验室(HKUDS)推出的轻量级开源智能体基础设施框架,仅用Python实现,代码量比Claude Code轻44倍(1.1万行vs 51万行),提供完整的工具调用、技能加载、记忆管理和多智能体协调功能,让开发者快速构建安全可靠的AI Agent应用。

文章要点:

- 极简架构设计:相比Claude Code的51万行TypeScript代码,OpenHarness仅用1.1万行Python实现,去除了企业级复杂依赖如遥测和OAuth,专注于核心Harness架构

- 五大核心模块:包含Agent循环(支持流式工具调用、并行执行、成本追踪)、工具套件(43种工具覆盖文件/Shell/搜索/Web/MCP)、上下文记忆(CLAUDE.md自动注入、MEMORY.md持久化)、权限治理(多级权限模式、交互式审批)、Swarm多智能体协调(子智能体委派、任务管理)

- 生态兼容性:完全兼容anthropics/skills技能格式和claude-code/plugins插件生态,支持OpenClaw、nanobot、Cursor等CLI工具集成

- 开箱即用:一条命令

文章URL:

https://github.com/HKUDS/OpenHarness

标签:#AI #Agent #智能体 #开源 #Python #工具调用

总结:

OpenHarness是港大数据智能实验室(HKUDS)推出的轻量级开源智能体基础设施框架,仅用Python实现,代码量比Claude Code轻44倍(1.1万行vs 51万行),提供完整的工具调用、技能加载、记忆管理和多智能体协调功能,让开发者快速构建安全可靠的AI Agent应用。

文章要点:

- 极简架构设计:相比Claude Code的51万行TypeScript代码,OpenHarness仅用1.1万行Python实现,去除了企业级复杂依赖如遥测和OAuth,专注于核心Harness架构

- 五大核心模块:包含Agent循环(支持流式工具调用、并行执行、成本追踪)、工具套件(43种工具覆盖文件/Shell/搜索/Web/MCP)、上下文记忆(CLAUDE.md自动注入、MEMORY.md持久化)、权限治理(多级权限模式、交互式审批)、Swarm多智能体协调(子智能体委派、任务管理)

- 生态兼容性:完全兼容anthropics/skills技能格式和claude-code/plugins插件生态,支持OpenClaw、nanobot、Cursor等CLI工具集成

- 开箱即用:一条命令

oh即可启动,内置114个单元测试和6个E2E测试套件,提供稳定可靠的基础能力文章URL:

https://github.com/HKUDS/OpenHarness

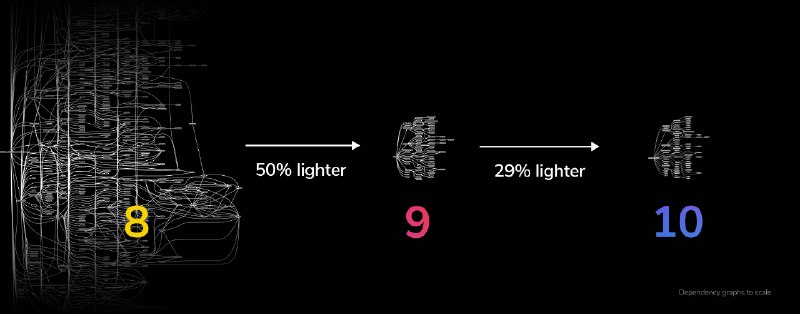

《Python 3.15的JIT编译器重回正轨》

标签:#Python #JIT #CPython #性能优化 #Faster_CPython #编译器 #开源社区

总结:

Python 3.15的JIT编译器开发取得突破性进展,在失去主要赞助商后通过社区协作成功实现性能目标。目前macOS AArch64平台比解释器快11-12%,Linux x86_64快5-6%,提前完成预定目标。文章强调了团队建设、任务分解和幸运的技术决策(如追踪记录解释器和引用计数消除)对项目成功的关键作用。

文章要点:

- **性能目标提前达成**:Python 3.15的JIT在macOS AArch64上比尾调用解释器快11-12%,在Linux x86_64上比标准解释器快5-6%,提前一年多完成目标

- **从困境中重生**:Faster CPython团队2025年失去主要赞助商后,通过社区托管模式维持开发,作者曾怀疑JIT项目能否成功

- **降低"巴士因子"风险**:团队计划在JIT的前端(区域选择器)、中端(优化器)、后端(代码生成器)各配备2名活跃维护者,目前中端已有4名贡献者

- **任务分解吸引新人**:将复杂优化问题拆分为简单任务(如"优化单条指令"),提供详细可操作的指导,让无JIT经验的C程序员也能参与,共11人参与核心重构

- **关键技术决策**:Brandt建议改用追踪式前端,Mark建议双分派表机制,意外地将追踪解释器性能从慢6%提升到快1.x%,并将JIT代码覆盖率提升50%

- **引用计数消除优化**:消除每条Python指令的分支操作,这一优化易于并行化且适合教学,是3.15版本的主要优化方向

- **基础设施支撑**:Savannah Ostrowski一人搭建了等效于整个基础设施团队的CI系统,每日性能测试帮助快速发现回归问题

文章URL:

https://fidget-spinner.github.io/posts/jit-on-track.html

标签:#Python #JIT #CPython #性能优化 #Faster_CPython #编译器 #开源社区

总结:

Python 3.15的JIT编译器开发取得突破性进展,在失去主要赞助商后通过社区协作成功实现性能目标。目前macOS AArch64平台比解释器快11-12%,Linux x86_64快5-6%,提前完成预定目标。文章强调了团队建设、任务分解和幸运的技术决策(如追踪记录解释器和引用计数消除)对项目成功的关键作用。

文章要点:

- **性能目标提前达成**:Python 3.15的JIT在macOS AArch64上比尾调用解释器快11-12%,在Linux x86_64上比标准解释器快5-6%,提前一年多完成目标

- **从困境中重生**:Faster CPython团队2025年失去主要赞助商后,通过社区托管模式维持开发,作者曾怀疑JIT项目能否成功

- **降低"巴士因子"风险**:团队计划在JIT的前端(区域选择器)、中端(优化器)、后端(代码生成器)各配备2名活跃维护者,目前中端已有4名贡献者

- **任务分解吸引新人**:将复杂优化问题拆分为简单任务(如"优化单条指令"),提供详细可操作的指导,让无JIT经验的C程序员也能参与,共11人参与核心重构

- **关键技术决策**:Brandt建议改用追踪式前端,Mark建议双分派表机制,意外地将追踪解释器性能从慢6%提升到快1.x%,并将JIT代码覆盖率提升50%

- **引用计数消除优化**:消除每条Python指令的分支操作,这一优化易于并行化且适合教学,是3.15版本的主要优化方向

- **基础设施支撑**:Savannah Ostrowski一人搭建了等效于整个基础设施团队的CI系统,每日性能测试帮助快速发现回归问题

文章URL:

https://fidget-spinner.github.io/posts/jit-on-track.html

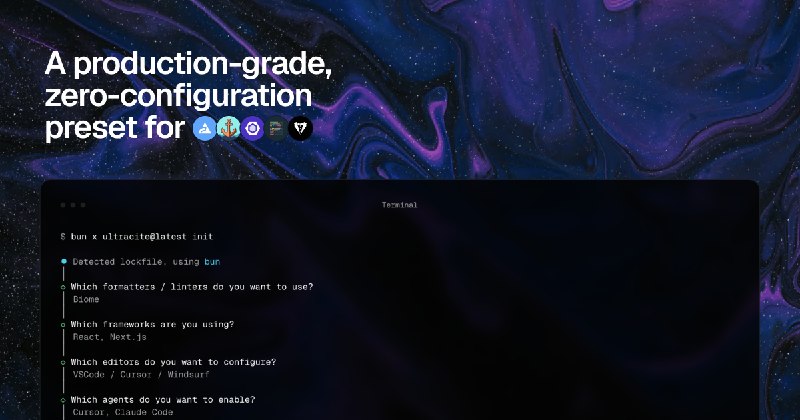

《Claude技能构建完整指南》

标签:#AI #Claude #MCP #Agent_Skills #Workflow_Automation #开发工具 #Anthropic

总结:Anthropic官方发布的Claude技能构建指南,系统介绍了如何通过SKILL.md文件创建可复用的AI工作流。技能采用渐进式披露架构(YAML前置元数据+Markdown指令+引用资源),可与MCP工具集成实现多步骤自动化。文档涵盖规划、测试、分发全流程,提供5种设计模式(顺序工作流、多MCP协调、迭代优化等),并给出量化评估指标(90%触发准确率、零API失败率),目标帮助开发者在15-30分钟内构建生产级AI技能。

文章要点:

- 技能定义:包含SKILL.md(必需)、scripts/、references/、assets/的文件夹结构,采用kebab-case命名规范,支持Claude.ai、Claude Code和API三端通用

- 渐进式披露设计:三级加载机制(YAML元数据→SKILL.md正文→链接资源),最小化token消耗同时保持专业性

- 三大应用场景:文档/资源创建(如前端设计)、工作流自动化(如项目管理)、MCP增强(如Sentry代码审查),后者将工具访问转化为可靠工作流

- 成功指标:技能应在90%相关查询中自动触发,单次工作流工具调用次数明确,零失败API调用,用户无需提示下一步操作

- 核心设计模式:顺序工作流编排、多MCP协调(跨Figma/Linear/Slack等)、迭代优化循环、上下文感知工具选择、领域特定智能(如合规检查)

- 测试策略:触发测试( obvious/paraphrased/negative cases)、功能测试、性能对比(有无技能时的token消耗和交互轮次差异)

- 分发方式:GitHub托管+Claude.ai设置上传,支持组织级部署和API程序化调用,定位为MCP的"知识层"(厨房类比:MCP是厨房设备,技能是食谱)

- 常见陷阱:描述字段过于模糊导致触发失败、包含XML标签的安全限制、README.md与SKILL.md混淆、指令过于冗长导致模型"懒惰"

https://resources.anthropic.com/hubfs/The-Complete-Guide-to-Building-Skill-for-Claude.pdf

标签:#AI #Claude #MCP #Agent_Skills #Workflow_Automation #开发工具 #Anthropic

总结:Anthropic官方发布的Claude技能构建指南,系统介绍了如何通过SKILL.md文件创建可复用的AI工作流。技能采用渐进式披露架构(YAML前置元数据+Markdown指令+引用资源),可与MCP工具集成实现多步骤自动化。文档涵盖规划、测试、分发全流程,提供5种设计模式(顺序工作流、多MCP协调、迭代优化等),并给出量化评估指标(90%触发准确率、零API失败率),目标帮助开发者在15-30分钟内构建生产级AI技能。

文章要点:

- 技能定义:包含SKILL.md(必需)、scripts/、references/、assets/的文件夹结构,采用kebab-case命名规范,支持Claude.ai、Claude Code和API三端通用

- 渐进式披露设计:三级加载机制(YAML元数据→SKILL.md正文→链接资源),最小化token消耗同时保持专业性

- 三大应用场景:文档/资源创建(如前端设计)、工作流自动化(如项目管理)、MCP增强(如Sentry代码审查),后者将工具访问转化为可靠工作流

- 成功指标:技能应在90%相关查询中自动触发,单次工作流工具调用次数明确,零失败API调用,用户无需提示下一步操作

- 核心设计模式:顺序工作流编排、多MCP协调(跨Figma/Linear/Slack等)、迭代优化循环、上下文感知工具选择、领域特定智能(如合规检查)

- 测试策略:触发测试( obvious/paraphrased/negative cases)、功能测试、性能对比(有无技能时的token消耗和交互轮次差异)

- 分发方式:GitHub托管+Claude.ai设置上传,支持组织级部署和API程序化调用,定位为MCP的"知识层"(厨房类比:MCP是厨房设备,技能是食谱)

- 常见陷阱:描述字段过于模糊导致触发失败、包含XML标签的安全限制、README.md与SKILL.md混淆、指令过于冗长导致模型"懒惰"

https://resources.anthropic.com/hubfs/The-Complete-Guide-to-Building-Skill-for-Claude.pdf

#开源 【RSC 除了 Nextjs 以外的选择,只是一个 vite 插件】这个新包可能有助于您基于 Fastify 网络服务器和 Vite 构建自己的自定义 React 元框架(创建自己的“Mini Next.js”)。它支持 React 19,RSC 将在以后推出。

https://fastify-vite.dev/

https://fastify-vite.dev/

#开源 #文章 styled-components 进入维护状态。

- React 核心团队已决定事实上弃用某些 API,例如 Context API(在 RSC 中不可用,且没有迁移路径。)

- 总体而言,生态系统已基本脱离 css-in-js 概念,而 tailwind 等其他技术的普及度则呈现爆炸式增长。

- quantizor (自 2018 年左右以来一直是 styled-components 的核心维护者)不再在大型应用程序中积极部署 styled-components 的生产,因此在实际产品中的使用环境将持续减弱并最终完全停止。

https://opencollective.com/styled-components/updates/thank-you

- React 核心团队已决定事实上弃用某些 API,例如 Context API(在 RSC 中不可用,且没有迁移路径。)

- 总体而言,生态系统已基本脱离 css-in-js 概念,而 tailwind 等其他技术的普及度则呈现爆炸式增长。

- quantizor (自 2018 年左右以来一直是 styled-components 的核心维护者)不再在大型应用程序中积极部署 styled-components 的生产,因此在实际产品中的使用环境将持续减弱并最终完全停止。

https://opencollective.com/styled-components/updates/thank-you

#开源 #AI 一个基于 UI-TARS(视觉-语言模型)的 GUI 代理应用程序,允许您使用自然语言控制您的计算机。需要配置模型,输入自己的 API KEY,目前仅支持 OpenAI 和 Claude

https://github.com/bytedance/UI-TARS-desktop

https://github.com/bytedance/UI-TARS-desktop

#开源 Lightpanda 浏览器是一款开源、超快、低内存的无头浏览器,专为网络自动化、AI训练和测试而设计。同时也兼容Playwright、Puppeteer。速度却是chrome headless的11倍

https://lightpanda.io/

https://lightpanda.io/